开yun体育网

开yun体育网

在科幻电影中,咱们总能看到动作优雅、活动天然的机器东说念主,它们步碾儿、跑步、甚而作念后空翻皆像真东说念主一样流通。但推行中的机器东说念主通常动作僵硬、胆寒不啻,就像一个刚学会步碾儿却总在抽搐的孩子。这种差距的根源在那儿?最近,来自机器东说念主AI究诘院的科学家们找到了谜底,并提议了一个篡改性的管理决议。

这项冲破性究诘发表于2026年2月的《ACM Transactions on Graphics》期刊,论文编号为arXiv:2602.18312v1。究诘团队发现,传统的机器东说念主限度系统就像一个神经质的司机,对标的盘的每一个眇小变化皆过度敏锐,收尾便是车子开得歪七扭八。而他们设备的新方法,就像给这个司机安设了一个"平滑驾驶助手",让机器东说念主的动作变得自但是优雅。

这个"平滑驾驶助手"的中枢是一个叫作念"动作雅可比刑事就业"的数学用具,配合一种全新的神经网罗架构——线性政策网罗。听起来很复杂?其实就像给机器东说念主装了一个"动作润滑器",让它的每个动作皆经过尽心调校,既能完成任务,又不会出现令东说念主难过的抽搐和胆寒。

究诘团队不仅在计较机仿真中考证了这个方法,还成效将其诳骗到了实在的四足机器东说念主身上。这个机器东说念主不仅能踏实行走,还能在行走的同期挥舞机械臂作念各式动作,就像一个优雅的杂技演员。更令东说念主惊叹的是,这套系统学习速率更快,计较遵循更高,况兼真的不需要针对具体任务进行复杂的参数休养。

一、传统机器东说念主限度的"抽搐病"

要泄漏这项究诘的进击性,咱们先得明白传统机器东说念主限度系统存在什么问题。设想一下,你正在学习开车。淌若你对标的盘过度敏锐,稍许嗅觉到车子偏离车说念就大幅度休养标的盘,收尾便是车子左摇右摆,乘客坐得头晕目眩。这便是传统机器东说念主限度系统面对的中枢问题。

深度强化学习天然在机器东说念主限度界限取得了强盛成效,好像让造谣变装和机器东说念主学会各式复杂动作,但它有一个致命过错:为了取得高分奖励,它通常会"钻空子",使用一些在推行寰宇中根底不成能竣事的高频率抽搐动作。这就像一个电子游戏玩家发现了游戏缺陷,通过豪恣点击鼠标来取得超高分数,但这种政策在推行中毫无真谛真谛。

这种问题在机器东说念主诳骗中绝顶严重。实在的机器东说念主受到物理收尾,传感器有噪声,电机反应有蔓延,淌若限度系统条件机器东说念主作念出超高频的动作变化,收尾不是动作失败,便是机器东说念主"发疯"般地胆寒。就像让一个东说念主在步碾儿时每隔0.01秒就改变一次步态,这显豁是不成能的。

以往管理这个问题的方法经常是在奖励函数中加入"动作变化刑事就业",就像告诉学开车的东说念主"每次大幅动弹标的盘就扣分"。但这种方法需要无数的试错来找到适合的刑事就业力度,况兼通常是"头痛医头,脚痛医脚",针对不同的任务需要不同的休养。更努力的是,淌若刑事就业太重,机器东说念主可能变得过于保守,连必要的快速动作皆不敢作念;淌若刑事就业太轻,又回到了原本抽搐的老问题。

最近有究诘尝试使用"利普希茨料理政策"来管理这个问题,这种方法通过收尾政策函数的变化率来确保平滑性。但这种方法计较复杂,需要无数非凡的计较资源,况兼主要适用于绵薄的畅通任务,面对更复杂的场景时遵循并不睬想。

二、篡改性的"动作雅可比刑事就业"——机器东说念主的平滑驾驶助手

面对这些挑战,究诘团队提议了一个全新的管理决议:动作雅可比刑事就业。这个倡导听起来很上流,但实质上就像给机器东说念主安设了一个"动作敏锐度检测器"。

咱们不错把机器东说念主的限度政策设想成一个复杂的函数机器:输入是机器东说念主现时的景象(位置、速率、角度等),输出是机器东说念主应该作念出的动作(要道角度、力矩等)。这个函数机器的"敏锐度"便是雅可比矩阵——它告诉咱们当输入景象发生眇小变化时,输挪动作会发生多大的变化。

淌若这个敏锐度很高,就像一个神经质的司机,稍许嗅觉到路况变化就作念出剧烈的操作休养,收尾便是车子开得颤颤巍巍。动作雅可比刑事就业的作用便是缩小这种敏锐度,让限度系统变得愈加"淡定",对景象变化作念出愈加巩固的反应。

具体来说,究诘团队在张望经过中径直对雅可比矩阵的大小进行刑事就业。这就像给司机制定了一个轨则:"不仅要看你开车的收尾,还要看你操作的巩固进程"。淌若某个限度政策对输入景象过于敏锐,即使它能完成任务,也会因为"动作不够优雅"而被扣分。

这种方法的上风在于它径直针对问题的根源。以往的方法是在收尾上作念著述(刑事就业连气儿动作之间的互异),而动作雅可比刑事就业是在泉源上管理问题(径直优化限度政策的敏锐性)。这就像从根底上培养一个司机的驾驶作风,而不是过后改进他的每一个动作。

更进击的是,这种方法真的不需要针对具体任务进行休养。究诘团队发现,在所有实验中,雷同的刑事就业权重(wJac = 10)皆能取得爽直遵循,这大大缩小了系统的使用门槛。

三、线性政策网罗——绵薄却强盛的新架构

天然动作雅可比刑事就业很有用,但计较这个刑事就业的经过相等耗尽资源。关于传统的全聚拢神经网罗,计较雅可比矩阵过火梯度需要进行复杂的反向传播计较,这会让张望时期加多50%以上。为了管理这个问题,究诘团队设备了一种全新的神经网罗架构——线性政策网罗(LPN)。

线性政策网罗的狡计想路绵薄而玄妙。传统的神经网罗径直输出机器东说念主的动作领导,就像一个"全能遥控器",每次皆要处理复杂的输入信息并径直给出具体的操作领导。而线性政策网罗更像一个"智能休养器",它不径直告诉机器东说念主该怎样动,而是生成一个"反应轨则"——当机器东说念主景象发生变化时,应该如何相应地休养动作。

具体来说,线性政策网罗由一个绵薄的多层感知机(MLP)构成,但它的输出不是动作自己,而是一个反馈矩阵Kt和一个前馈项kt。最终的限度动作通过一个绵薄的线性公式计较:at = Ktst + kt + at,其中st是机器东说念主现时景象,at是参考动作。

这种狡计的玄妙之处在于,它将复杂的非线性限度问题攻击为时变线性限度问题。就像用一套随时期变化的"范例操作规程"来领导机器东说念主动作,而不是每次皆从头想考该怎样办。

更神奇的是,在这种架构下,计较动作雅可比刑事就业变得极其绵薄。由于最终动作是景象的线性函数,动作对景象的雅可比矩阵就等于反馈矩阵Kt自己。这意味着计较雅可比刑事就业不需要任何非凡的计较支拨,就像顺带张望一下反应轨则的合感性一样绵薄。

究诘团队率先驰念这种简化的架构可能会收尾限度政策的抒发身手,毕竟线性函数的复杂度远低于深度神经网罗。但实验收尾令东说念主诧异:线性政策网罗不仅莫得影响性能,在某些任务上甚而弘扬更好。这解释了关于好多畅通限度任务,时变线性限度政策就富余强盛。

四、从仿真到推行——全地方的考阐述验

为了考证新方法的有用性,究诘团队狡计了一系列全面的实验,覆盖勤俭单步碾儿到复杂技巧动作的各式场景。

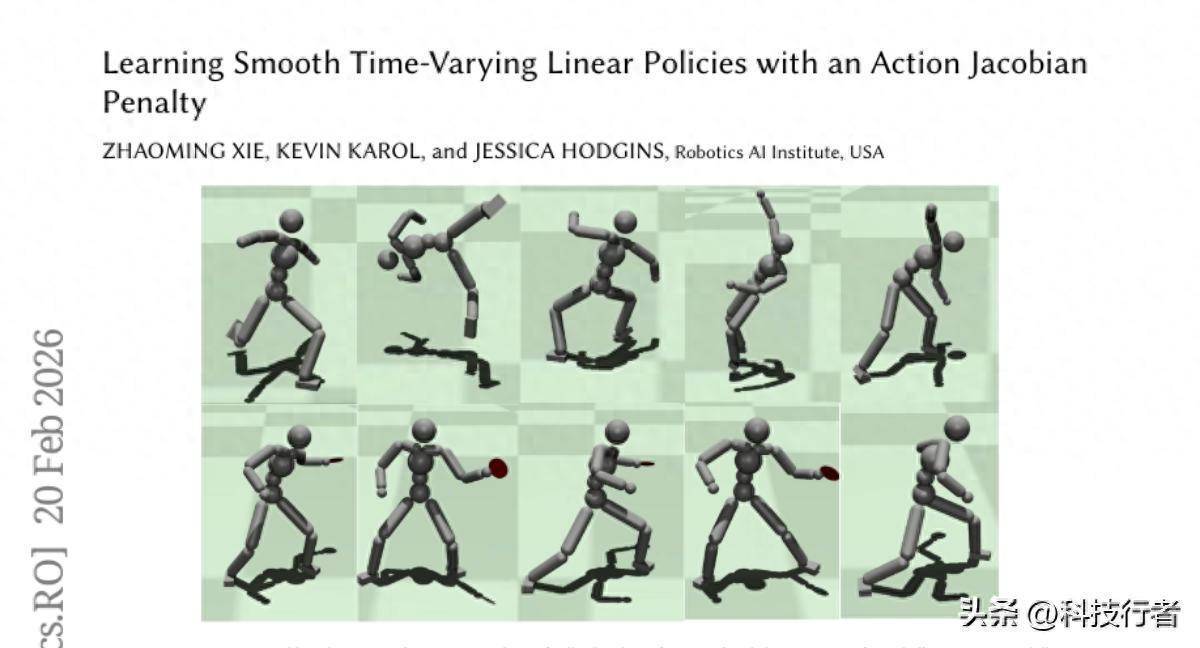

在东说念主形变装仿实在验中,究诘团队继承了四类不同难度的任务。发轫是基础的畅通任务,包括步碾儿和跑步,这访佛于教机器东说念主学会最基本的移入手段。接着是体操动作,包括后空翻、侧空翻和侧手翻等高难度动作,这就像让机器东说念主学会作念各式体操技巧。第三类是单一序列师法,比如15秒的乒乓球步法张望和轰隆舞动作,这纯属系统对复杂、非周期性动作的学习身手。终末是环境交互任务,包括跑酷动作如反向跳马、攀爬和双kong突出,以及足球颠球等需要与环境复杂交互的动作。

实验收尾令东说念主印象真切。在所有测试任务中,使用线性政策网罗和动作雅可比刑事就业的系统皆弘扬出了最快的学习料理速率。更进击的是,通过多种平滑度方针的评估,包括动作平滑度、高频信号比例和畅通抖动进程,新方法在绝大多数情况下皆权贵优于传统方法。

绝顶值得审视的是后空翻任务的收尾。这个动作对机器东说念主来说极具挑战性,需要在空中进行快速旋转并精准着地。传统的动作变化刑事就业方法淌若刑事就业过重,根底无法学会这个动作;淌若刑事就业过轻,又会产生无数的高频抖动。而线性政策网罗配合动作雅可比刑事就业的方法,既成效学会了后空翻动作,又保合手了相对平滑的限度信号。

究诘团队还进行了一系列深入的分析实验。他们发现学到的线性政策不错进行低秩近似,这意味着复杂的限度政策实质上不错用更绵薄的样貌示意。举例,一个28维的行走政策不错降维到14维甚而2维,仍然保合手基本的行走身手,尽管畅通质地会有所下落。

在地形适合性测试中,究诘团队将在深渊上张望的后空翻和侧手翻政策诳骗到不屈坦的正弦地形上,发现这些线性政策具有很好的鲁棒性,好像处理环境扰动。

五、实在机器东说念主的成效诳骗——从仿真走向推行

仿实在验的成效仅仅第一步,实在的纯属是能否在实在的机器东说念主上就业。究诘团队继承了一个改装的四足机器东说念主手脚测试平台,这个机器东说念主访佛于着名的波士顿能源Spot机器东说念主,但加装了一个机械臂。

在实在机器东说念主上部署限度政策面对诸多挑战。发轫是传感器噪声和膨胀器蔓延,这些在仿真中不存在的问题会放大限度信号中的任何不踏实因素。其次是计较资源收尾,机器东说念主的车载计较机无法像服务器那样进行复杂的神经网罗推理。

线性政策网罗在这些挑战面前展现了私有上风。由于最终的限度计较仅仅绵薄的矩阵乘法,究诘团队不错事先计较好一系列反馈矩阵,然后在动手时径直查表使用。这大大缩小了及时计较的包袱,让机器东说念主好像以15Hz的频率更新限度政策,同期以30Hz的频率计较要道主义角度。

实验中的实在机器东说念主需要完成两个复杂任务。第一个任务是在踏实行走的同期进行快速的机械臂畅通,这就像让一个东说念主边步碾儿边作念手语一样,需要精准的全身合作。第二个任务愈加穷苦:机器东说念主需要完成联结敏捷突出和机械臂挥击的组合动作,访佛于东说念主类乒乓球选手的步法配合击球动作。

令东说念主欣忭的是,使用新方法张望的机器东说念主成效完成了这些任务。机器东说念主的动作流通天然,莫得出现传统方法常见的抖动和不踏实征象。更进击的是,所有这个词系统的计较遵循很高,为更复杂的及时限度任务留住了计较资源余量。

六、深入分析——为什么绵薄的方法如斯有用

这项究诘最令东说念主诧异的发现之一是,线性政策网罗这种相对绵薄的架构居然好像匹敌甚而超越传统的深度神经网罗。这个发现挑战了"越复杂越好"的常见融会,揭示了畅通限度界限的一些深档次特征。

从限度表面的角度来看,好多复杂的畅通其实不错剖释为一系列相对绵薄的线性限度问题。就像一个优秀的钢琴家,天然好像演奏复杂的乐曲,但每个瞬息的手指动作皆罢职着相对绵薄的肌肉限度规矩。时变线性反馈限度恰是捕捉了这种特征:在职何给定时刻,最优的限度政策可能皆相对绵薄,复杂性体面前这些绵薄政策如何随时期变化。

究诘团队通过奇异值剖释分析发现,学到的反馈矩阵具有昭彰的低秩结构。这意味着28个要道的限度实质上不错归结为少数几个主要的合作模式。举例,行走运的限度主要波及前后均衡和傍边舞动两个主要模式,其他细节动作皆是这些主模式的组合变化。

这种低维结构也解释了为什么线性政策网罗具有更好的泛化身手。与试图学习高维复杂函数的深度网罗比拟,线性政策网罗专注于学习少数几个症结的合作模式,这些模式在面对环境变化时愈加踏实。

究诘团队还发现,动作雅可比刑事就业实质上起到了隐式正则化的作用。它不仅让限度信号更平滑,还促使网罗学习愈加泛化的特征示意。这就像给学习经过加了一个"优雅度评价",不仅温雅能否完成任务,还温雅完成任务的形式是否天然合理。

七、与传统方法的全面对比——新方法的上风安在

为了全面评估新方法的性能,究诘团队将其与多种现存的平滑化方法进行了翔实对比。这些对譬如法包括无正则化的基线方法、不同权重的动作变化刑事就业、利普希茨料理政策,以及使用传统神经网罗的动作雅可比刑事就业。

在学习遵循方面,线性政策网罗配合动作雅可比刑事就业展现出昭彰上风。在所有测试任务中,这种组合皆能最快达到料理,经常在2000次迭代(约1小时张望时期)内就能学会复杂动作,而传统方法通常需要5000次迭代或更多。

从计较遵循角度看,新方法的上风愈加昭彰。传统的动作雅可比刑事就业方法天然能产生平滑的限度政策,但每次张望迭代的时期加多了50%以上。而线性政策网罗的动作雅可比刑事就业真的莫得非凡的计较支拨,张望时期与基线方法基本相等。

在限度质地评估中,究诘团队使用了三个症结方针。动作平滑度揣测连气儿时期步之间的动作变化大小;高频信号比例计较限度信号中突出10Hz频率身分的能量占比,因为东说念主类的限度带宽经常不突出10Hz;畅通抖动度则通过要道加快度的抖动进程来评价畅通的天然性。

在这三个方针上,线性政策网罗皆弘扬优异。绝顶值得审视的是高频信号比例,传统方法的这一方针通常突出20%,而新方法经常能限度在5%以下,权贵接近东说念主类限度的天然特征。

但是,究诘团队也本分地阐述了方法的局限性。在后空翻这类极其动态的动作中,由于动作自己就需要快速的景象变化,动作雅可比刑事就业或然会收尾必要的快速反应。这导致在某些动态动作中,传统的动作变化刑事就业方法在特定缔造下可能产生更低的畅通抖动度。

八、技能细节与竣事——让复杂变绵薄

关于想要深入了解技能竣事的读者,这套系统的架构狡计体现了"化繁为简"的工程灵巧。

线性政策网罗的输入特征狡计经过尽心沟通。不同于传统方法使用机器东说念主的全局坐标信息,新方法选择最小坐标系统,包括机器东说念主根部联系于主义位置的偏移、根部线速率和角速率、各要道的角度和角速率。这种狡计不仅简化了景象示意,还便于从仿真系统转移到实在机器东说念主,因为这些信息皆不错通过范例的机器东说念主传感器取得。

网罗架构自己保合手简陋:一个两层的多层感知机,粉饰层包含256个神经元。输出层生成反馈矩阵Kt和前馈项kt,然后通过线性变换at = Ktst + kt + at计较最终限度动作。这种狡计让所有这个词限度政策的参数数目远少于传统深度网罗,但抒发身手却不忘形。

在张望经过中,系统使用PPO(近端政策优化)算法,这是强化学习中的范例方法。总的亏蚀函数联结了原始的PPO损构怨动作雅可比刑事就业:Ltotal = LPPO + wJacLJac,其中wJac = 10在所有实验中皆固定不变,这大大简化了超参数调优就业。

绝顶玄妙的是动作雅可比刑事就业的计较形式。关于传统神经网罗,计较雅可比矩阵需要复杂的反向传播经过。而关于线性政策网罗,由于at = Ktst + kt + at,动作对景象的雅可比矩阵便是Kt自己开yun体育网,刑事就业项LJac =